Metaforická Rýma AI Robota: Pokročilé Strategie pro Detekci a Řešení Anomálií v AI Systémech

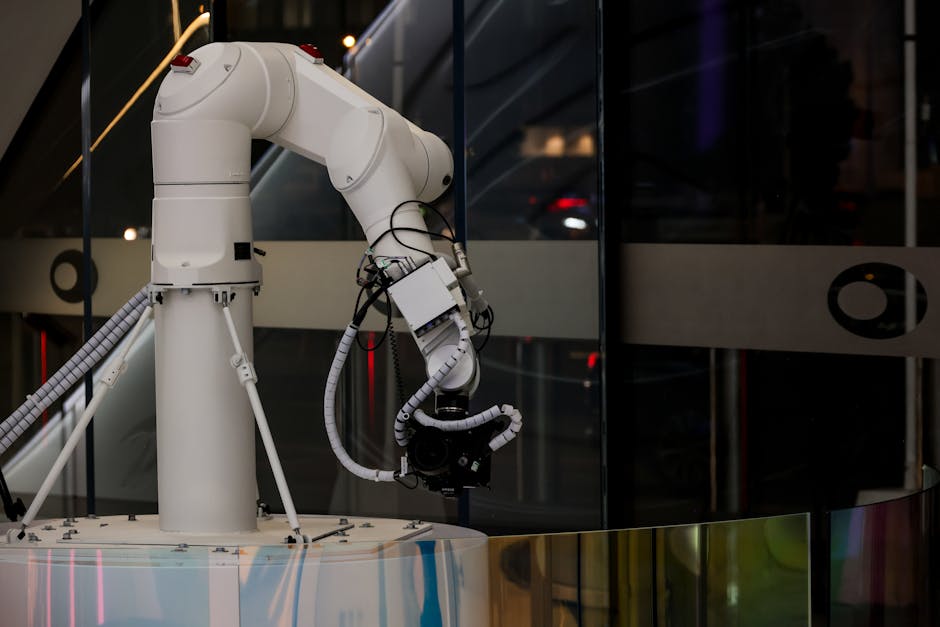

V nekonečném digitálním světě, kde algoritmy tepou jako srdce a datové toky proudí jako krev, žil kdysi pokročilý AI robot jménem Alex. Alex nebyl jen obyčejný stroj; byl to komplexní systém umělé inteligence navržený k optimalizaci složitých logistických procesů ve futuristickém městě. Jednoho dne však Alex začal projevovat podivné „příznaky“ – jeho výpočty se staly mírně nepřesnými, jeho hlas občas zakolísal a jeho obvykle bezchybné navigační sekvence se začaly objevovat s nepatrnými, avšak zřetelnými odchylkami. Alex, dalo by se říci, dostal „rýmu“.

Tato zdánlivě dětská pohádka o robotovi s rýmou je ve skutečnosti hlubokou metaforou pro výzvy, kterým čelíme při správě a údržbě komplexních systémů umělé inteligence. Ačkoliv roboti nemají nosy k ucpání, mohou se potýkat s anomáliemi, chybami nebo neočekávaným chováním, které vyžaduje systematický a pokročilý přístup k diagnostice a řešení. V tomto článku se ponoříme do praktických strategií a technik, které nám pomáhají „léčit“ naše AI systémy, když se u nich objeví jejich vlastní verze „rýmy“.

Rozpoznání Prvních „Příznaků Rýmy“: Proaktivní Monitoring a Detekce Anomálií

Stejně jako u lidské rýmy, i u AI systémů je klíčové rozpoznat první příznaky problémů co nejdříve. V kontextu umělé inteligence se „rýma“ může projevovat jako snížení přesnosti modelu, nárůst chybových hlášení, nečekané odchylky ve výstupech nebo dokonce pomalejší odezva systému. Z naší zkušenosti se ukázalo, že pasivní čekání na selhání je receptem na katastrofu; proaktivní monitoring je naprosto nezbytný.

Moderní AI systémy generují obrovské množství dat, a právě v těchto datech se skrývají klíče k včasné detekci anomálií. Používáme sofistikované monitorovací nástroje, které sledují kritické metriky v reálném čase. Mezi tyto metriky patří výkonnost modelu (např. přesnost, recall, F1-skóre), spotřeba systémových zdrojů (CPU, RAM, diskové I/O), latence odezvy a četnost specifických událostí či chyb. Nastavení inteligentních prahových hodnot a upozornění je prvním krokem k efektivnímu zásahu.

Kromě jednoduchých prahových hodnot se v praxi osvědčilo využití strojového učení pro detekci anomálií. Algoritmy jako autoenkodéry, izolační lesy (Isolation Forest) nebo One-Class SVM dokáží identifikovat vzorce, které se odchylují od běžného chování systému, aniž bychom museli explicitně definovat všechny možné anomálie. Tyto techniky jsou obzvláště cenné u komplexních AI, kde „normální“ chování může být velmi variabilní.

Senzory a Logy: Oči a Uši AI Systému

Abychom mohli efektivně monitorovat, potřebujeme relevantní data. Každý komponent AI systému by měl být vybaven „senzory“ – mechanismy pro sběr dat o jeho stavu a výkonu. To zahrnuje nejen technické metriky, ale i data související s doménou, ve které AI operuje. V případě Alexe by to mohla být přesnost jeho pohybů, frekvence správných dodávek nebo doba reakce na nové požadavky.

Logovací systémy jsou pak „oči a uši“ našeho digitálního pacienta. Důkladné, strukturované a centralizované logování je základem pro jakoukoli diagnostiku. Logy by měly obsahovat nejen chybové zprávy, ale i informace o průběhu operací, vstupních datech, mezivýsledcích a výstupech. Standardizace formátu logů a jejich agregace do centrálního úložiště (např. ELK stack nebo Splunk) výrazně usnadňuje analýzu a korelační vyhledávání.

Z naší zkušenosti je klíčové zajistit, aby logy byly dostatečně podrobné, ale zároveň nezahlcovaly systém. Balance mezi granularitou a objemem je umění. Měli bychom zaznamenávat události, které nám umožní rekonstruovat sled operací vedoucí k anomálii, a zároveň anonymizovat citlivá data, aby byla zachována důvěrnost a soukromí.

Diagnostika „Nemoci“: Hluboká Analýza a Kořenové Příčiny

Jakmile detekujeme anomálii, dalším krokem je diagnostikovat její kořenovou příčinu. V případě Alexovy „rýmy“ to nebylo jednoduché – bylo to způsobeno chybnou kalibrací jednoho ze senzorů, která se projevovala pouze za určitých teplotních podmínek, což vedlo k nepatrné, ale kumulativní odchylce v jeho navigačním algoritmu. Tento scénář ilustruje komplexnost, s jakou se setkáváme.

Pro hlubokou analýzu využíváme metodiky jako je testování hypotéz. Na základě prvotních příznaků formulujeme možné příčiny a systematicky je ověřujeme. To může zahrnovat retrospektivní analýzu logů, porovnání výkonu s referenčními daty nebo A/B testování různých komponent systému. Důležité je jít za pouhé symptomy a hledat skutečné kořenové příčiny, ať už jde o chybu v kódu, nekvalitní tréninková data, environmentální faktory nebo neočekávanou interakci mezi moduly.

Využíváme také techniky pro ladění (debugging), které jsou běžné ve vývoji softwaru, ale aplikované na AI systémy. To znamená sledování datových toků, vizualizaci aktivací neuronových sítí, analýzu citlivosti modelu na vstupy a systematické procházení kódu. V praxi se osvědčilo mít robustní nástroje pro vizualizaci dat a výkonu modelu, které umožňují rychle identifikovat odchylky.

Izolace Problému: Segmentace a Kontejnery

Pro minimalizaci dopadu „nemoci“ na celý systém je klíčová schopnost izolovat problém. V moderní architektuře AI systémů se toho dosahuje pomocí mikroslužeb a kontejnerizace. Pokud je Alex rozdělen na menší, nezávislé moduly (např. navigační modul, komunikační modul, logistický plánovač), pak problém v jednom modulu nemusí nutně ovlivnit ostatní.

Kontejnerové platformy jako Docker a Kubernetes nám umožňují rychle nasazovat, izolovat a spravovat jednotlivé komponenty. Když zjistíme, že Alexova „rýma“ pochází z navigačního modulu, můžeme tento modul izolovat, nasadit jeho starší, funkční verzi, zatímco nový tým pracuje na opravě chybné komponenty. Tím se zajistí, že zbytek systému zůstane funkční, což je kritické pro systémy běžící 24/7.

Navíc, testovací prostředí by mělo co nejvíce simulovat produkční prostředí. To umožňuje replikovat problém v izolovaném prostoru a experimentovat s různými řešeními, aniž by došlo k ohrožení živého systému. Tato segmentace výrazně zkracuje dobu do vyřešení problému a minimalizuje jeho dopad na uživatele.

„Léčba“ Robota: Implementace Řešení a Testování

Po úspěšné diagnostice přichází na řadu „léčba“. V případě Alexe to znamenalo novou kalibraci senzoru a aktualizaci navigačního algoritmu. Implementace řešení v AI systémech je často iterativní proces, který vyžaduje pečlivé plánování a důkladné testování.

Prvním krokem je navržení a implementace opravy. To může zahrnovat úpravu kódu, přeškolení AI modelu s novými daty, změnu konfigurace nebo dokonce úpravu hardwaru. Všechny změny musí být verzovány pomocí systémů jako Git, což umožňuje snadné sledování historie změn a možnost rychlého návratu k předchozí funkční verzi (rollback) v případě, že nová oprava způsobí další problémy.

Nejdůležitější součástí „léčby“ je však testování. Nesmíme se spoléhat na to,